文章目录

- 下面内容由AI生成,仅供参考,AI也可能会犯错。请核查重要信息。

- 前言

- 1. 数据收集与准备

- 2. 选择开源大模型

- 3. 定制和微调模型

- 微调文本模型

- 微调图像模型

- 4. 验证与测试

- 5. 部署与维护

- 参考资源

下面内容由AI生成,仅供参考,AI也可能会犯错。请核查重要信息。

训练专业场景的AI模型,尤其是针对特定领域

- 数据收集与准备

- 选择开源大模型

- 定制和微调模型

- 验证与测试

- 部署与维护

前言

盘点开源大模型:

- Llama 2

- CodeGeeX

- MiniGPT-4

- OPT

- CPM

- CPM-2

- CodeGen

- BLOOM

- GLM-130B

- mT5

- ChatGLM2-6B

1. 数据收集与准备

收集和准备高质量的数据是训练AI模型的基础。对于公司所涉及的专业领域,可以从以下几个来源收集数据:

- 公司内部数据

- 公开数据集

- 文献与研究论文

- 行业报告与标准

数据类型包括:

- 文本数据:技术文档、研究论文、手册、标准等。

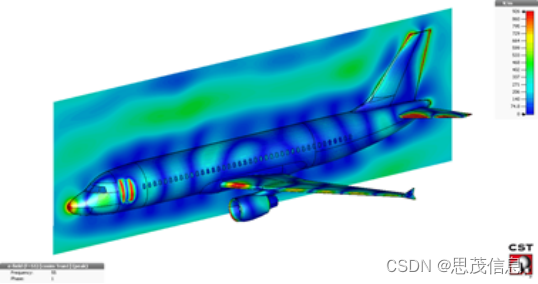

- 图像数据

- 传感器数据

2. 选择开源大模型

基于主流的开源大模型进行微调。常见的开源大模型包括:

- GPT-3 / GPT-4:适用于自然语言处理任务,可以处理技术文档和文本数据。

- BERT / RoBERTa:适用于文本理解和分类任务。

- Vision Transformers (ViT):适用于图像处理任务。

- OpenAI CLIP:适用于结合图像和文本数据的任务。

3. 定制和微调模型

根据收集的数据,对开源大模型进行微调。具体步骤如下:

微调文本模型

- 准备数据:将文本数据整理为适合模型输入的格式。

- 使用Hugging Face Transformers:可以使用Hugging Face的Transformers库进行微调。

from transformers import AutoModelForSequenceClassification, Trainer, TrainingArguments from transformers import AutoTokenizer model_name = "bert-base-uncased" model = AutoModelForSequenceClassification.from_pretrained(model_name, num_labels=2) tokenizer = AutoTokenizer.from_pretrained(model_name) # 加载和处理数据 # 例如:datasets = load_dataset('path_to_your_dataset') training_args = TrainingArguments( output_dir='./results', num_train_epochs=3, per_device_train_batch_size=16, per_device_eval_batch_size=16, warmup_steps=500, weight_decay=0.01, logging_dir='./logs', ) trainer = Trainer( model=model, args=training_args, train_dataset=datasets['train'], eval_dataset=datasets['test'] ) trainer.train()

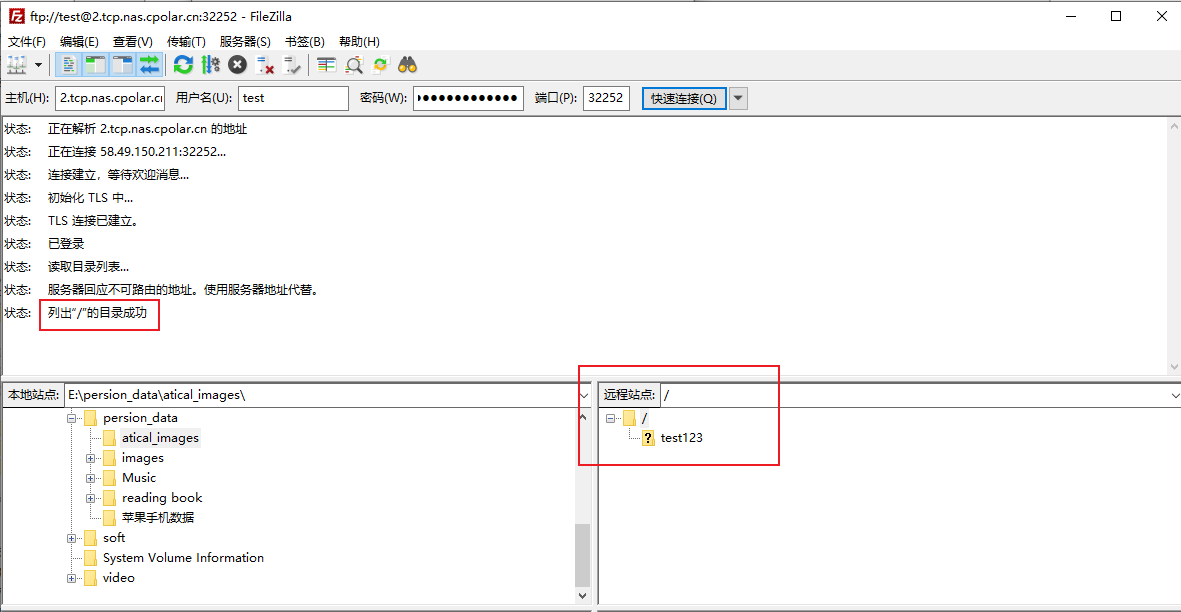

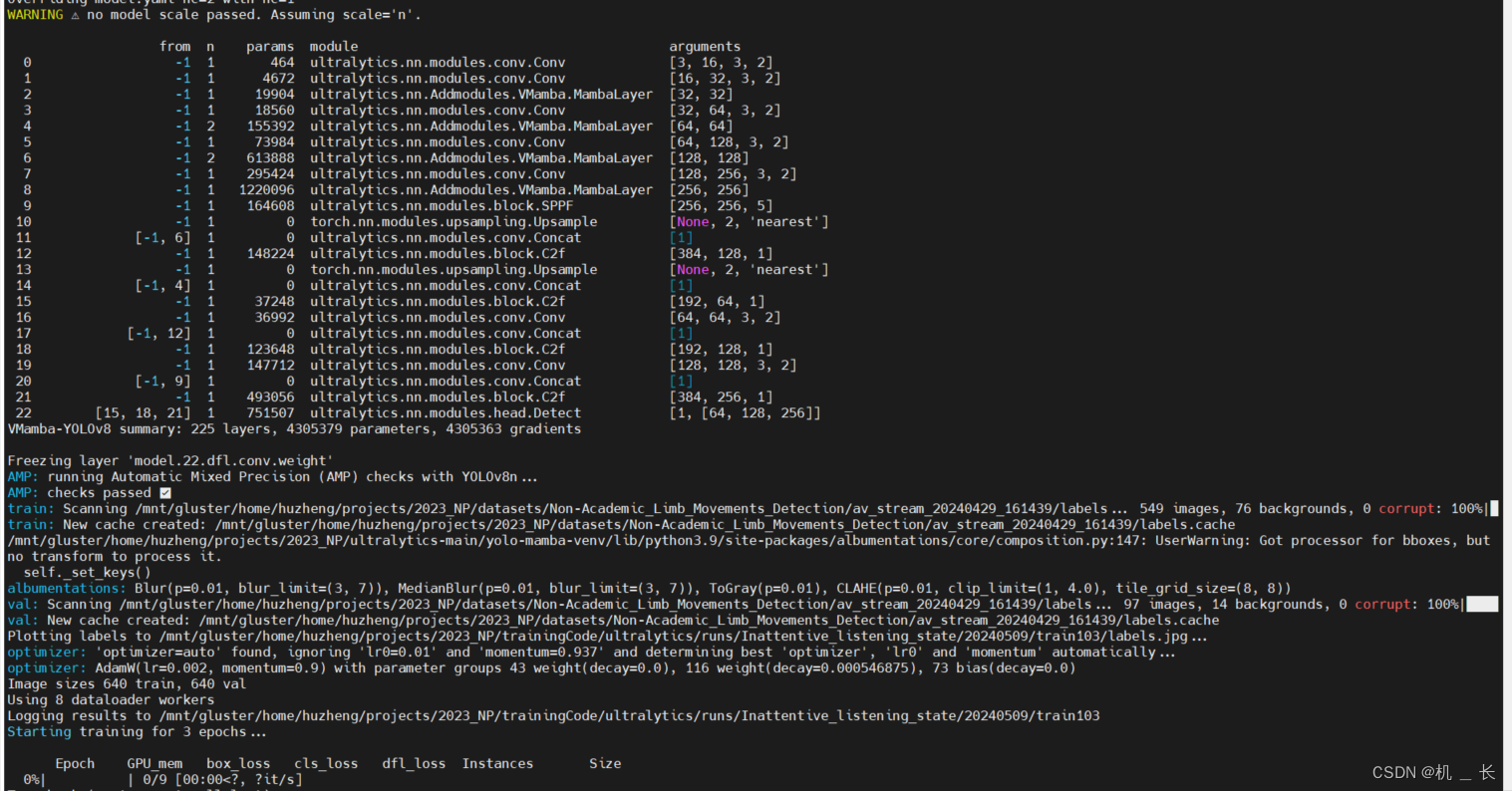

微调图像模型

- 准备图像数据:将图像数据整理为适合模型输入的格式。

- 使用PyTorch或TensorFlow:可以使用PyTorch或TensorFlow进行图像模型的微调。

import torch import torchvision.models as models from torchvision import datasets, transforms model = models.resnet50(pretrained=True) num_ftrs = model.fc.in_features model.fc = torch.nn.Linear(num_ftrs, 2) data_transforms = transforms.Compose([ transforms.Resize(256), transforms.CenterCrop(224), transforms.ToTensor(), ]) image_datasets = datasets.ImageFolder('path_to_data', transform=data_transforms) dataloaders = torch.utils.data.DataLoader(image_datasets, batch_size=32, shuffle=True) criterion = torch.nn.CrossEntropyLoss() optimizer = torch.optim.SGD(model.parameters(), lr=0.001, momentum=0.9) # 训练模型 num_epochs = 25 for epoch in range(num_epochs): # 训练步骤 ...

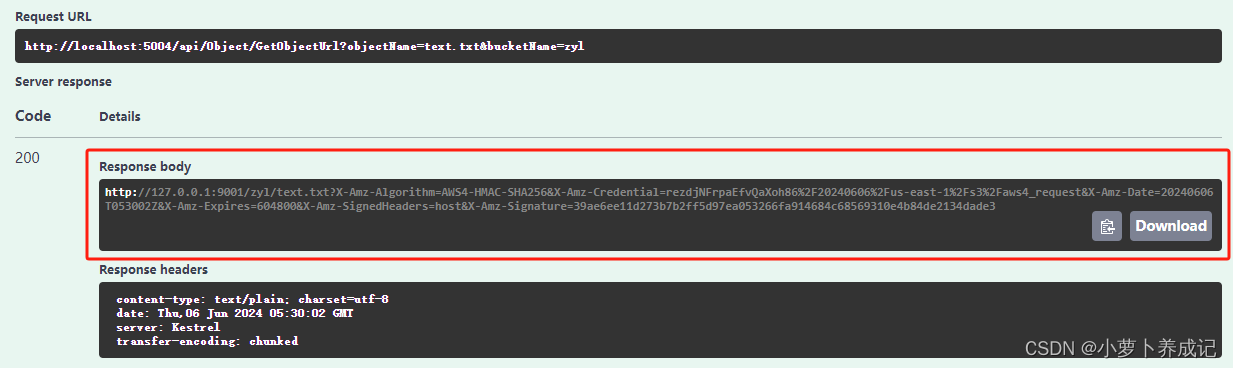

4. 验证与测试

验证和测试模型的性能,确保模型在专业场景中的准确性和鲁棒性。

- 分割数据集:使用训练集、验证集和测试集进行评估。

- 评估指标:使用准确率、召回率、F1分数等指标评估模型性能。

- 交叉验证:通过交叉验证确保模型的泛化能力。

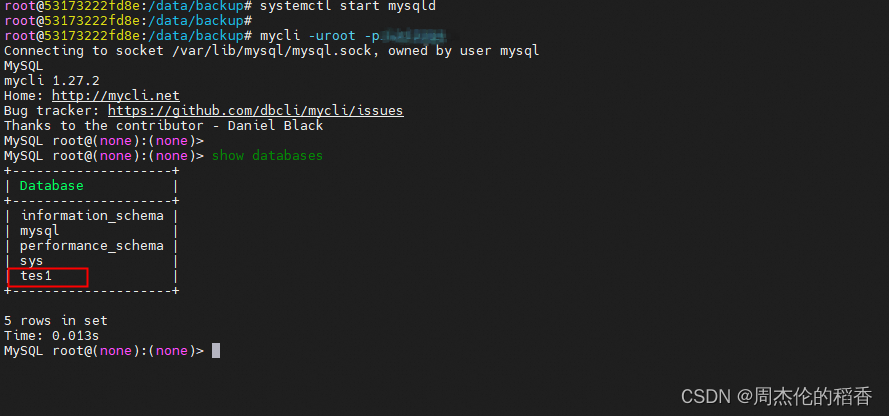

5. 部署与维护

将训练好的模型部署到生产环境,并定期进行维护和更新。

- 部署平台:选择适当的平台(如AWS、Azure、GCP或公司内部服务器)进行部署。

- API接口:通过API接口(如RESTful API)提供模型服务。

- 监控与更新:持续监控模型的性能,并根据需要进行更新和重新训练。

参考资源

- Hugging Face Transformers:https://huggingface.co/transformers/

- PyTorch:https://pytorch.org/

- TensorFlow:https://www.tensorflow.org/

- OpenAI GPT:https://github.com/openai/gpt-3

- Vision Transformers (ViT):https://github.com/google-research/vision_transformer